上海H100GPU貨期

–私有云執行官什么時候會有H100繼任者?#可能要到2024年底(2024年中期到2025年初)才會公布,基于Nvidia架構之間的歷史時間。在此之前,H100將成為NvidiaGPU的前列產品。(GH200和DGXGH200不算在內,它們不是純GPU,它們都使用H100作為他們的GPU)會有更高的顯存H100嗎?#也許是液冷120GBH100s。短缺何時結束?#與我交談過的一個團體提到,它們實際上在2023年底之前已售罄。采購H100#誰賣H100?#戴爾,HPE,聯想,Supermicro和Quanta等OEM銷售H100和HGXH100。30當你需要InfiniBand時,你需要直接與Nvidia的Mellanox交談。31因此,像CoreWeave和Lambda這樣的GPU云從OEM購買,然后租給初創公司。超大規模企業(Azure,GCP,AWS,Oracle)更直接地與Nvidia合作,但他們通常也與OEM合作。即使對于DGX,您仍然會通過OEM購買。您可以與英偉達交談,但您將通過OEM購買。您不會直接向Nvidia下訂單。交貨時間如何?#8-GPUHGX服務器上的提前期很糟糕,而4-GPUHGX服務器上的提前期很好。每個人都想要8-GPU服務器!如果一家初創公司***下訂單,他們什么時候可以訪問SSH?#這將是一個交錯的部署。假設這是一個5,000GPU的訂單。他們可能會在2-000個月內獲得4,000或4,5個。H100 GPU 提供高效的 GPU 直連技術。上海H100GPU貨期

H100 GPU 還集成了多種先進的安全和管理功能。例如,它支持 NVIDIA 的 GPU Direct 技術,能夠實現 GPU 之間的直接通信,減少了 CPU 參與的數據傳輸延遲,提升了數據傳輸效率。此外,H100 GPU 還支持多種虛擬化技術,如 NVIDIA vGPU,能夠在虛擬化環境中提供高性能的圖形和計算服務。其多樣化的管理和安全功能,使得 H100 GPU 在企業級數據中心和云計算平臺中具備了更高的適用性和管理便捷性。在能效方面,H100 GPU 也表現優異。其功耗設計為 400W,但在實際使用中,通過優化負載分配和動態電壓頻率調節(DVFS)技術,可以有效降低功耗,提高能效比。對于需要長時間運行的大規模計算任務,H100 GPU 的高能效設計不僅可以降低運營成本,還減少了對環境的影響。其先進的功耗管理技術確保了在提供高性能計算的同時,依然能夠保持較低的能源消耗。NVLINKH100GPU折扣H100 GPU 支持 Tensor Core 技術。

H100 GPU 通過其強大的計算能力和高效的數據傳輸能力,為分布式計算提供了強有力的支持。其并行處理能力和大帶寬內存可以高效處理和傳輸大量數據,提升整體計算效率。H100 GPU 的穩定性和可靠性為長時間高負荷運行的分布式計算任務提供了堅實保障。此外,H100 GPU 的靈活擴展能力使其能夠輕松集成到各種分布式計算架構中,滿足不同應用需求,成為分布式計算領域的重要工具。H100 GPU 的市場價格在過去一段時間內經歷了明顯的波動。隨著高性能計算需求的增加,H100 GPU 在人工智能、深度學習和大數據分析等領域的應用越來越多,市場需求不斷攀升,推動了價格的上漲。同時,全球芯片短缺和物流成本的上升也對 H100 GPU 的價格產生了不利影響。盡管如此,隨著供應鏈的逐步恢復和市場需求的平衡,H100 GPU 的價格有望在未來逐漸回落。對于企業和研究機構來說,了解價格動態并選擇合適的采購時機至關重要。

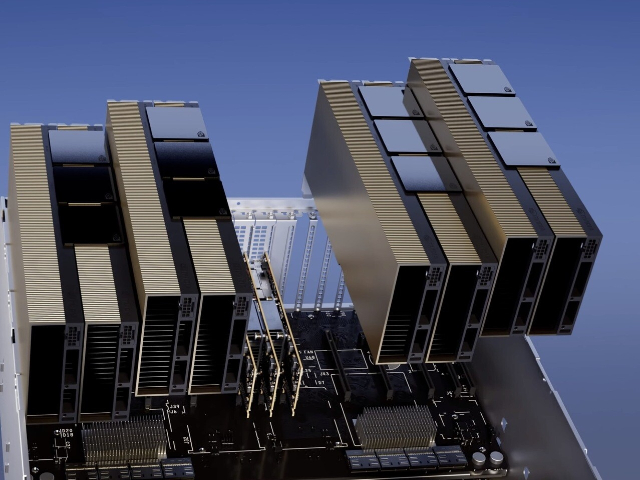

增加了一個稱為線程塊集群(ThreadBlockCluster)的新模塊,集群(Cluster)是一組線程塊(ThreadBlock),保證線程可以被并發調度,從而實現跨多個SM的線程之間的**協作和數據共享。集群還能更有效地協同驅動異步單元,如張量內存***(TensorMemoryAccelerator)和張量NVIDIA的異步事務屏障(“AsynchronousTransactionBarrier”)使集群中的通用CUDA線程和片上***能夠有效地同步,即使它們駐留在單獨的SM上。所有這些新特性使得每個用戶和應用程序都可以在任何時候充分利用它們的H100GPU的所有單元,使得H100成為迄今為止功能強大、可編程性強、能效高的GPU。組成多個GPU處理集群(GPUProcessingClusters,GPCs)TextureProcessingClusters(TPCs)流式多處理器(StreamingMultiprocessors,SM)L2CacheHBM3內存控制器GH100GPU的完整實現8GPUs9TPCs/GPU(共72TPCs)2SMs/TPC(共144SMs)128FP32CUDA/SM4個第四代張量/SM6HBM3/HBM2e堆棧。12個512位內存控制器60MBL2Cache第四代NVLink和PCIeGen5H100SM架構引入FP8新的Transformer引擎新的DPX指令H100張量架構專門用于矩陣乘和累加(MMA)數學運算的高性能計算,為AI和HPC應用提供了開創性的性能。H100 GPU 提供高效的功耗管理。

ITMALL.sale 始終堅持以客戶為中心的服務理念,不斷提升自身的服務水平和產品質量。通過建立嚴格的質量控制體系,ITMALL.sale 確保每一臺 H100 GPU 產品都經過嚴格檢測,確保性能穩定和可靠。ITMALL.sale 還與多家企業建立了長期合作關系,憑借良好的信譽和質量的服務贏得了客戶的信賴。ITMALL.sale 的目標是成為 H100 GPU 市場的,為客戶提供質量的產品和服務,助力客戶業務的快速發展。ITMALL.sale 以其質量的服務和產品在市場上贏得了良好的口碑。作為 H100 GPU 的專業代理商,ITMALL.sale 不僅能夠提供具有競爭力的價格,還能夠確保產品的質量和可靠性。通過與 NVIDIA 的緊密合作,ITMALL.sale 能夠及時獲取的產品信息和技術更新,為客戶提供的 H100 GPU 產品和技術解決方案。無論是企業級客戶還是個人用戶,都能夠在 ITMALL.sale 找到滿足其需求的 H100 GPU 產品和服務。H100 GPU 特價出售,數量有限。Dubai超微H100GPU

H100 GPU 在科學計算領域表現出色。上海H100GPU貨期

L2CacheHBM3內存控制器GH100GPU的完整實現8GPUs9TPCs/GPU(共72TPCs)2SMs/TPC(共144SMs)128FP32CUDA/SM4個第四代張量/SM6HBM3/HBM2e堆棧,12個512位內存控制器60MBL2Cache第四代NVLink和PCIeGen5H100SM架構引入FP8新的Transformer引擎新的DPX指令H100張量架構專門用于矩陣乘和累加(MMA)數學運算的高性能計算,為AI和HPC應用提供了開創性的性能。H100中新的第四代TensorCore架構提供了每SM的原始稠密和稀疏矩陣數學吞吐量的兩倍支持FP8、FP16、BF16、TF32、FP64、INT8等MMA數據類型。新的TensorCores還具有更**的數據管理,節省了高達30%的操作數交付能力。FP8數據格式與FP16相比,FP8的數據存儲需求減半,吞吐量提高一倍。新的TransformerEngine(在下面的章節中進行闡述)同時使用FP8和FP16兩種精度,以減少內存占用和提高性能,同時對大型語言和其他模型仍然保持精度。用于加速動態規劃(“DynamicProgramming”)的DPX指令新引入的DPX指令為許多DP算法的內循環提供了高等融合操作數的支持,使得動態規劃算法的性能相比于AmpereGPU高提升了7倍。L1數據cache和共享內存結合將L1數據cache和共享內存功能合并到單個內存塊中簡化了編程。上海H100GPU貨期

- 上海H100GPU多少錢 2025-02-11

- QatarH100GPU price 2025-02-11

- 廣東H100GPU多少錢一臺 2025-02-10

- A900-IMA8S1Z 購買 2025-02-10

- TaiwanH100GPU貨期 2025-02-07

- A900-IMA1Z8S-CX 價格 2025-02-07

- 上海H100GPU貨期 2025-02-06

- 套裝H100GPU一臺多少錢 2025-02-06

- A900-IMA8CS1Z-M Iran 2025-02-05

- A900-IMA8S1Z 許可 2025-02-05

- 寧波人員考勤防爆手機定制廠家 2025-02-11

- 南京防火人員考勤防爆手機公司 2025-02-11

- 武漢專業人員管理防爆手機廠家 2025-02-11

- 廈門人員報警防爆手機廠商 2025-02-11

- 上海小區售貨機軟件定制 2025-02-11

- 廣州光傳感3芯光纖扇入扇出器件 2025-02-11

- 淄博信號設備全生命周期管理 2025-02-11

- 廣東信息化至盛ACM2188現貨 2025-02-11

- 哈爾濱定制LED報警海螺聯動燈 2025-02-11

- 北京配電室微機五防系統 2025-02-11